简介

LangDB AI Gateway 提供与 OpenAI 兼容的 API,用于连接多个大型语言模型,并作为可观测性平台,可轻松端到端追踪 CrewAI 工作流,同时提供对 350 多个语言模型的访问。通过单个init() 调用,所有代理交互、任务执行和 LLM 调用都会被捕获,为您的应用程序提供全面的可观测性和生产就绪的 AI 基础设施。

LangDB CrewAI 追踪示例

功能

AI 网关功能

- 访问 350+ LLM:通过单一集成连接所有主要语言模型

- 虚拟模型:创建具有特定参数和路由规则的自定义模型配置

- 虚拟 MCP:实现与 MCP(模型上下文协议)系统的兼容性和集成,以增强代理通信

- 护栏:为代理行为实施安全措施和合规性控制

可观测性和追踪

- 自动追踪:单个

init()调用捕获所有 CrewAI 交互 - 端到端可见性:从头到尾监控代理工作流

- 工具使用追踪:追踪代理使用的工具及其结果

- 模型调用监控:深入了解 LLM 交互

- 性能分析:监控延迟、token 使用和成本

- 调试支持:逐步执行以进行故障排除

- 实时监控:实时追踪和指标仪表板

设置说明

1

安装 LangDB

安装带有 CrewAI 功能标志的 LangDB 客户端

2

设置环境变量

配置您的 LangDB 凭据

3

初始化追踪

在配置您的 CrewAI 代码之前导入并初始化 LangDB

4

使用 LangDB 配置 CrewAI

使用 LangDB 标头设置您的 LLM

快速入门示例

这是一个简单的示例,可帮助您开始使用 LangDB 和 CrewAI完整示例:研究和规划代理

这个全面的示例展示了一个具有研究和规划能力的多代理工作流。先决条件

环境设置

完整实现

运行示例

在 LangDB 中查看追踪

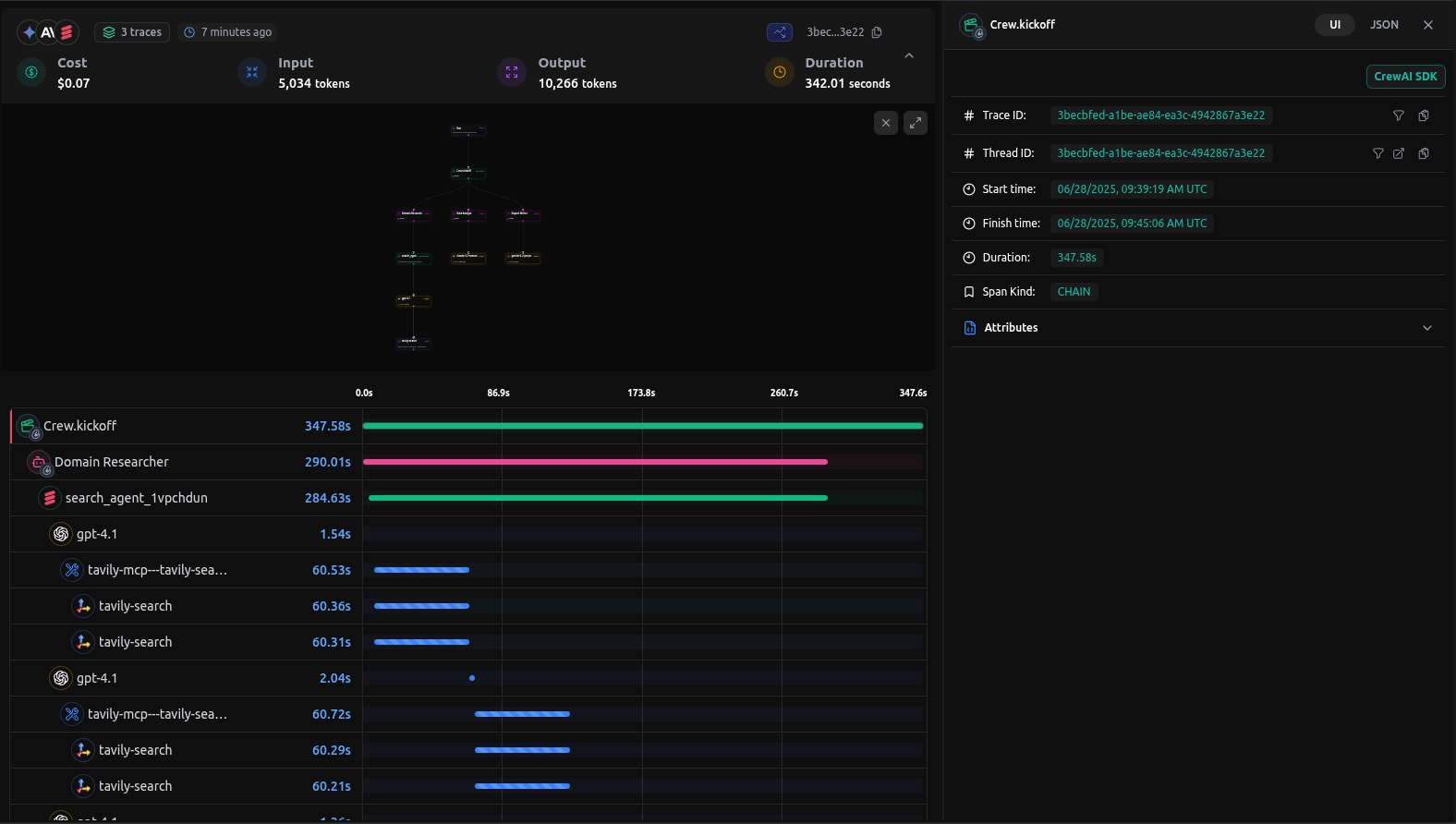

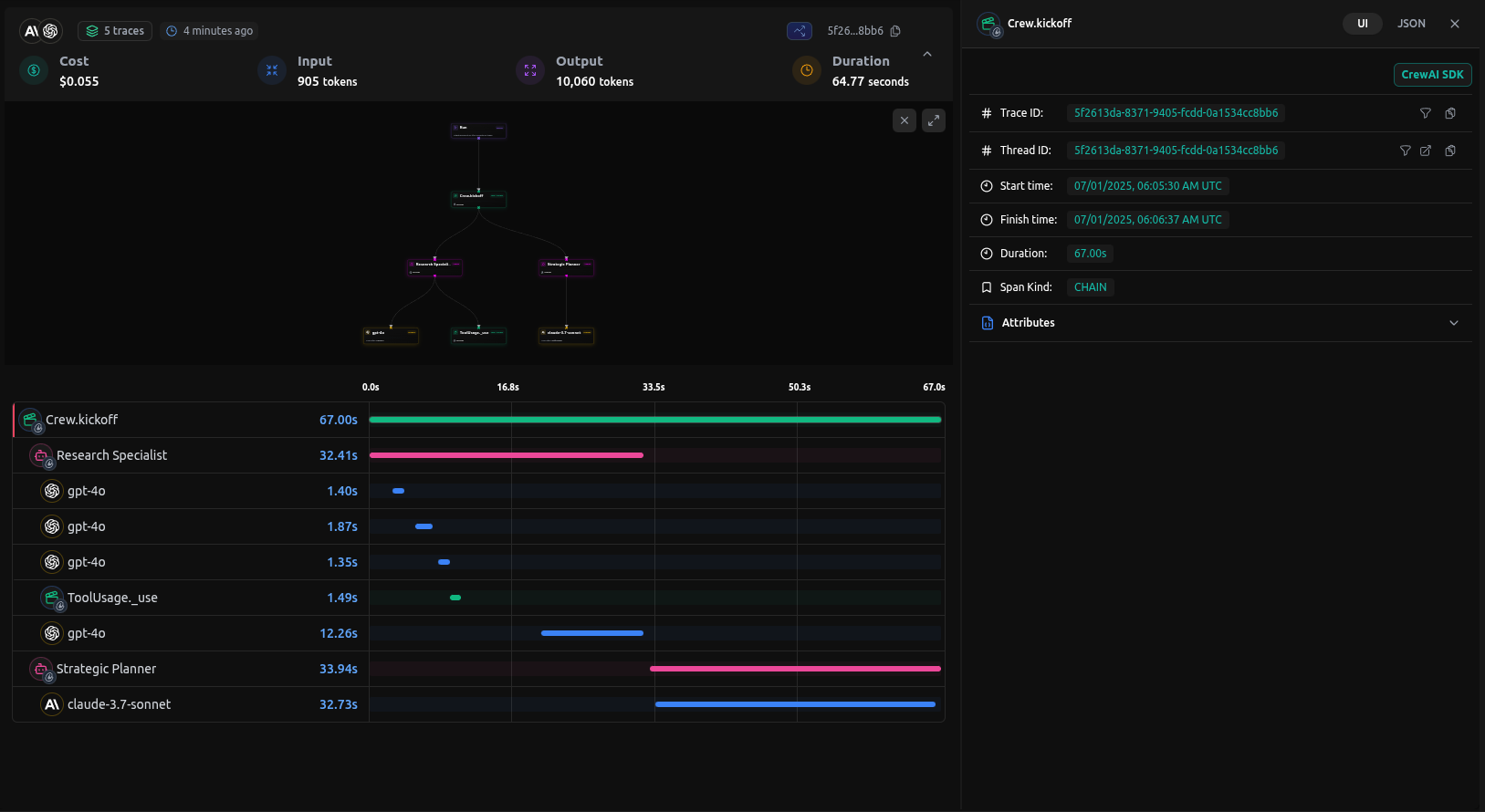

运行 CrewAI 应用程序后,您可以在 LangDB 仪表板中查看详细追踪

LangDB 追踪仪表板

您将看到什么

- 代理交互:代理对话和任务移交的完整流程

- 工具使用:调用了哪些工具、它们的输入和输出

- 模型调用:带有提示 image.png 和响应的详细 LLM 交互

- 性能指标:延迟、token 使用和成本追踪

- 执行时间线:整个工作流的逐步视图

故障排除

常见问题

- 未出现追踪:确保在任何 CrewAI 导入之前调用

init() - 身份验证错误:验证您的 LangDB API 密钥和项目 ID

资源

LangDB 文档

官方 LangDB 文档和指南

LangDB 指南

构建 AI 代理的分步教程

GitHub 示例

完整的 CrewAI 集成示例

LangDB 仪表板

访问您的追踪和分析

模型目录

浏览 350+ 可用语言模型

企业功能

自托管选项和企业功能

后续步骤

本指南涵盖了 LangDB AI Gateway 与 CrewAI 集成的基础知识。要进一步增强您的 AI 工作流,请探索- 虚拟模型:创建具有路由策略的自定义模型配置

- 护栏与安全:实施内容过滤和合规性控制

- 生产部署:配置回退、重试和负载均衡